A Meta em guerra contra o "wokismo" — o que pode dar errado? Quanto custa a "genialidade" de Musk?

Primeira resposta: muita coisa. Segunda resposta: muito dinheiro. O pior de tudo: a conta vai cair em nossas costas. kkkk? Não, escrever assim também não pega bem. Confira

A Meta afirma que quer remover o enviesamente do seus modelos, mas isso é mais difícil — e mais perigoso — do que parece.

Primeiro, um pouco de contexto. “Wokismo” é um aportuguesamento (abrasileiramento?) do termo “woke”, que se originou do verbo inglês wake ("acordar") e, em contextos sociais e políticos, passou a significar estar "desperto" ou consciente sobre injustiças sociais e desigualdades. Inicialmente, foi utilizado por comunidades afro-americanas nos Estados Unidos para descrever a consciência sobre o racismo sistêmico e outras formas de opressão.

O uso do termo remonta à década de 1930, quando o cantor folk Lead Belly usou a expressão "stay woke" como um alerta para que os afro-americanos permanecessem atentos às injustiças raciais. Nos anos 1960, "woke" ganhou destaque em movimentos pelos direitos civis e, mais recentemente, foi revitalizado com o movimento Black Lives Matter, ampliando seu significado para incluir causas como igualdade de gênero, direitos LGBTQIA+ e justiça climática.

Atualmente, "woke" é um termo polarizador. Para progressistas, representa um compromisso com a justiça social e a equidade. Para críticos, especialmente em setores conservadores, tornou-se sinônimo de "excesso de correção política" ou "cultura do cancelamento", sendo usado de forma pejorativa para descrever ações ou políticas consideradas excessivamente progressistas.

Um artigo do site Axios.com, traduzido/adaptado abaixo, discute a “iniciativa antiviés” da Meta. O problema é que parece ser apenas um esforço para atender à guerra da direita contra a “woke AI” e menos sobre a neutralidade dos modelos, de acordo com especialistas.

Na sequência, um artigo do Futurism.com apresenta a conta que o contribuinte dos EUA vai pagar pelas ideias geniais da dupla trump-musk.

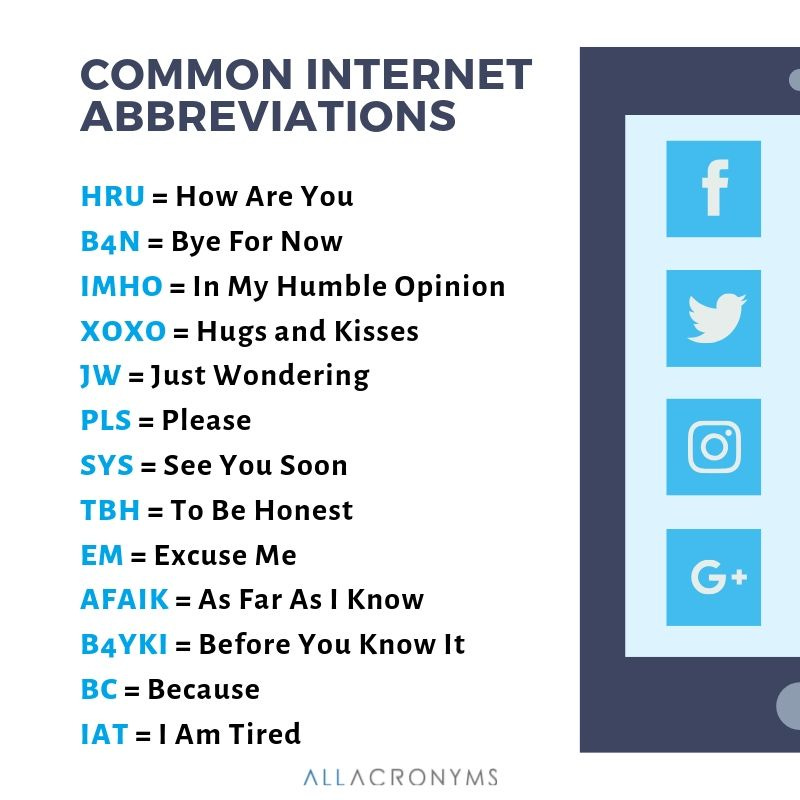

E, finalmente, um artigo publicado no site The Conversation e assinado por David Fang, que está cursando o PhD em marketing da Stanford University. O tema pode até parecer superficial, mas eu sugiro levarmos a sério uma vez que ele está realizando estudos muito interessantes sobre como a mania de usarmos abreviações, principalmente engraçadinhas, pode estar colocando em perigo o diálogo genuíno.

Antes de mergulhar nos artigos, o haikai. Ele está no meu A Perspectiva do Salto e me pareceu bem adequado para constar junto com estes artigos que exploram delusões

Flores pixadas no muro

Permitem ver a face de um deus

E a nuca do demo

E agora, continuemos…

A guerra da Meta contra "woke"

Quando o Llama 4 foi lançado no início deste mês, a Meta publicou um post afirmando que "é sabido que todos os principais LLMs tiveram problemas com vieses — especificamente, [porque] eles historicamente se inclinam para a esquerda quando se trata de tópicos políticos e sociais debatidos". "Nosso objetivo é remover o viés de nossos modelos de IA e garantir que o Llama possa entender e articular ambos os lados de uma questão controversa", disse a Meta.

Bem, há de fato uma disputa em andamento — tanto nos EUA quanto globalmente — sobre quais valores os sistemas de IA refletirão. Mas nem o problema nem as soluções são tão claros quanto o blog da Meta sugere.

De acordo com uma pesquisa da Universidade de Washington, da Universidade Carnegie Mellon e da Universidade Xi'an Jiaotong em 2023, o Llama dava respostas com vieses mais autoritários e de direita aos prompts (o ChatGPT dava as respostas mais esquerdistas).

E existem todos os tipos de vieses em modelos de linguagem de grande porte, muito além de uma questão de direita versus esquerda.

A questão é que fazer com que um modelo de grande porte responda de uma maneira específica não é fácil. Mas existem algumas maneiras de se ajustar, disse Vaibhav Srivastav, chefe de comunidade e colaborações da Hugging Face.

Antes de um modelo ser treinado, você pode fazer escolhas sobre quais dados são incluídos e excluídos e também como as várias fontes são ponderadas.

Na fase pós-treinamento, também conhecida como ajuste fino, os criadores do modelo podem usar diferentes técnicas para orientá-lo. Um método, conhecido como aprendizado por reforço a partir de feedback humano, funciona informando ao modelo quais tipos de respostas são preferenciais.

Outro método é fornecer prompts adicionais no nível do sistema que alteram a forma como uma resposta aparece. Esta é uma ferramenta contundente que corre o risco de consequências não intencionais, como quando a Meta e o Google tentaram neutralizar o preconceito e acabaram gerando imagens implausíveis e historicamente imprecisas — como pais fundadores negros e soldados nazistas de etnias diversas.

A ação da Meta disparou o alarme para pesquisadores e grupos de direitos humanos, que temem que a Meta pareça estar direcionando a Llama para a direita.

"É uma jogada ideológica bastante descarada para efetivamente fazer propostas ao governo Trump", disse Alex Hanna, diretor de pesquisa do Distributed AI Research Institute.

Além disso, a Meta e a Grok se posicionaram como modelos que responderão a perguntas que outros recusam, uma postura que preocupa alguns especialistas em IA. A Meta não apenas declarou isso como uma meta, mas também indicou que fez progressos com a Llama 4, que, segundo a empresa, "recusa menos em tópicos políticos e sociais debatidos em geral (de 7% na Llama 3.3 para menos de 2%)".

No entanto, o pesquisador sênior do Allen Institute, Jesse Dodge, diz que isso não é tão bom. "Recusas são uma parte importante da construção de um modelo e de ter um modelo que seja utilizável por muitas pessoas", disse ele. "Não sei por que eles anunciariam que ele recusa muito menos."

Enquanto Meta e Grok acusam outros modelos de IA de terem um viés de esquerda, especialistas dizem que a realidade é mais complexa. Grande parte do viés decorre dos dados de treinamento.

Embora a maioria dos principais modelos não divulgue seus conjuntos de dados específicos, é geralmente sabido, neste momento, que os principais modelos coletaram a maior parte da internet que não está protegida por um acesso pago. Como muitos desses dados de treinamento estão em inglês, especificamente no dialeto americano, os modelos de IA tendem a ser tendenciosos em relação às perspectivas capturadas nesse idioma.

A GLAAD, a organização de direitos LGBTQ+, disse à Axios que já notou o Llama 4 fazendo referência a práticas desacreditadas de terapia de conversão em algumas consultas.

"O binarismo que equipara ciência anti-LGBTQ a fatos e pesquisas bem estabelecidos não é apenas enganoso — ele legitima falsidades prejudiciais", disse um porta-voz da GLAAD.

"Todas as principais organizações médicas, psiquiátricas e psicológicas condenaram a chamada 'terapia de conversão', e as Nações Unidas a compararam à 'tortura'."

O artigo completo, em inglês, pode ser lido aqui

O artigo sobre o custo do DOGE (é assustador!)

Elon Musk está desperdiçando uma quantia absurda de dinheiro dos contribuintes devido à sua impressionante incompetência

O esforço do bilionário Elon Musk para livrar o governo do suposto "desperdício e fraude" está sendo um fracasso retumbante. Com seu chamado Departamento de Eficiência Governamental, o homem mais rico do mundo fez pouco para realmente economizar dinheiro, reduzindo suas ambições de uma promessa inicial de US$ 2 trilhões em economias para meros US$ 150 bilhões no início deste mês — um valor que continua altamente não confiável.

Pior ainda, o DOGE de Musk pode estar custando ao governo muito mais do que economiza — um desperdício astronômico de dinheiro do contribuinte que resultou em dor e sofrimento imensos e desnecessários.

Como relata o New York Times, demissões em massa e posterior recontratação de milhares de funcionários do setor público podem custar mais de US$ 135 bilhões somente neste ano fiscal. E a Receita Federal, que perdeu milhares de funcionários devido aos cortes, deve arrecadar impressionantes US$ 500 bilhões a menos neste ano após o derramamento de sangue, uma perda que ofusca as economias limitadas de Musk.

Leia o artigo completo, em inglês, aqui

O texto do Fang

Por que você deve pensar duas vezes antes de usar abreviações como "obg" e "kkkk" em suas mensagens

As mensagens de texto do meu irmão podem parecer fragmentos de um código antigo: "hru", "wyd", "plz" — truncadas, enigmáticas e nunca muito satisfatórias de receber. Muitas vezes me pego em dúvida se "gr8" significa entusiasmo de verdade ou se é um aceno superficial. [Explicação: “hru” = “how are you”, “wyd” = “what (are) you doing”, “plz = “please, “gr8 = “great”]

Essa estranheza me incomoda há anos, então acabei embarcando em uma série de estudos com os colegas pesquisadores Sam Maglio e Yiran Zhang. Eu queria saber se essas mensagens curtas poderiam minar o diálogo genuíno, explorando os sinais tácitos por trás da abreviação digital.

À medida que coletávamos dados, pesquisávamos pessoas e montávamos experimentos, ficou claro que esses pequenos atalhos — às vezes aclamados como uma marca registrada da comunicação eficiente — minavam os relacionamentos em vez de simplificá-los.

Palavras curtas levam à sensação de ter sido enganado

A maioria das pessoas digita "ty" e "brb" – de "obrigado" e "já volto" – sem pestanejar.

Em uma pesquisa que realizamos com 150 usuários de mensagens de texto com idades entre 18 e 65 anos, 90,1% relataram usar abreviações regularmente em suas mensagens diárias, e 84,2% acreditavam que esses atalhos tinham um efeito positivo ou nenhum impacto significativo na forma como as mensagens eram percebidas pelos destinatários.

Mas nossas descobertas sugerem que a mera inclusão de abreviações, embora aparentemente inofensiva, começa a parecer um descaso. Em outras palavras, sempre que um usuário de mensagens reduz as palavras às suas consoantes, os destinatários sentem falta de esforço, o que os faz se desligar.

É um fenômeno sutil, mas generalizado, que a maioria das pessoas não intui.

Começamos com testes controlados de laboratório, apresentando a 1.170 participantes com idades entre 15 e 80 anos uma de duas trocas de mensagens de texto quase idênticas: uma com várias abreviações e a outra com todas as letras. Em todos os cenários, os participantes classificaram o remetente da abreviação como menos sincero e muito menos digno de uma resposta.

Quanto mais aprofundamos a pesquisa, mais consistente o padrão se tornou.

Se as pessoas estavam lendo mensagens sobre planos de fim de semana ou eventos importantes da vida, a presença de palavras e frases truncadas como "plz", "sry" ou "idk" para "please", "sorry" ou "i'm not know" fazia com que os destinatários se sentissem prejudicados.

O fenômeno não se limitou a estranhos. Em mais experimentos, testamos se a proximidade alterava a dinâmica. Se você está enviando mensagens para um amigo querido ou um parceiro romântico, consegue abreviar o quanto quiser?

Evidentemente que não. Até mesmo pessoas que se imaginavam conversando com um amigo de longa data relataram se sentir um pouco incomodadas com palavras escritas pela metade, e essa sensação de decepção diminuiu a autenticidade da interação.

Do Discord aos aplicativos de namoro

Ainda assim, tínhamos dúvidas persistentes: seria apenas um efeito artificial de laboratório?

Nos perguntamos se pessoas reais em plataformas reais poderiam se comportar de maneira diferente. Então, levamos nossas perguntas ao Discord, uma vibrante comunidade social online onde as pessoas conversam sobre tudo, de animes a política. Mais importante ainda, o Discord está cheio de jovens que usam abreviações como se fossem naturais.

Enviamos mensagens para usuários aleatórios pedindo que recomendassem programas de TV para assistir. Um conjunto de mensagens descrevia completamente nossa pergunta; o outro conjunto estava cheio de abreviações. Fiéis aos resultados do nosso laboratório, menos pessoas responderam à pergunta abreviada. Mesmo entre os nativos digitais – usuários jovens, antenados em tecnologia e bem versados na linguagem casual das mensagens de texto – um texto repleto de atalhos ainda parecia malfeito.

Se algumas letras faltando podem azedar conversas casuais, o que acontece quando o amor entra em cena? Afinal, as mensagens de texto se tornaram um pilar do romance moderno, desde flertes tímidos até confissões reveladoras. Será que um "por favor, me ligue" poderia inadvertidamente comprometer uma conexão em desenvolvimento? Ou "e aí?" sugere mais apatia do que afeto? Essas perguntas guiaram nossa próxima incursão, enquanto nos propusemos a descobrir se a rápida eficiência das abreviações poderia, na verdade, interromper a delicada dança do namoro e da intimidade.

Nosso salto para o reino do romance culminou no Dia dos Namorados com um experimento de encontros rápidos online.

Emparelhamos os participantes para "encontros" programados dentro de um portal de mensagens privadas e oferecemos a metade deles pequenos incentivos para que suas respostas fossem preenchidas com abreviações como "obrigado" em vez de "obrigado".

Quando chegou a hora de trocar informações de contato, os participantes que receberam bilhetes cheios de abreviações mostraram-se notavelmente mais relutantes, alegando falta de esforço da outra parte. Talvez a evidência mais reveladora tenha vindo de um estudo separado que analisou profundamente centenas de milhares de conversas no Tinder. Os dados mostraram que mensagens repletas de abreviações como "u" e "rly" obtiveram menos respostas gerais e interromperam conversas.

O pensamento é o que importa

Queremos deixar claro: não estamos fazendo campanha para proibir o "lol". Nossa pesquisa sugere que algumas abreviações dispersas não necessariamente arruínam uma amizade. Nem todas as muitas mensagens enviadas a muitas pessoas todos os dias justificam o tratamento completo de ortografia. Não se importa em parecer sincero? Não precisa que o destinatário responda? Então, por favor, abrevie.

Em vez disso, é a dependência generalizada de frases condensadas que reduz consistentemente nossa impressão da sinceridade do remetente. Quando digitamos "plz" uma dúzia de vezes em uma conversa, corremos o risco de transmitir que a outra pessoa não vale as letras extras. O efeito pode ser sutil em uma única troca. Mas, com o tempo, ele se acumula.

Se o seu objetivo final é nutrir uma conexão mais profunda – seja com um amigo, um irmão ou um possível encontro – dedicar um segundo a mais para digitar "obrigado" pode ser um investimento inteligente.

As abreviações começaram como uma solução inteligente para celulares de flip desajeitados, com suas mensagens de texto no teclado – lembro de ter tocado "5" três vezes para digitar a letra "L" – e limites mensais rígidos de caracteres. No entanto, aqui estamos, muito tempo depois daqueles dias, ainda lidando com "omg" e "brb", como se a necessidade nunca tivesse fim.

Depois de todos esses estudos, voltei às mensagens do meu irmão com um olhar renovado. Desde então, compartilhei com ele nossas descobertas sobre como esses pequenos atalhos podem parecer indiferentes ou sem entusiasmo. Ele ainda dispara "já volto" em metade das mensagens, e provavelmente nunca o verei digitar "me desculpe" por completo. Mas algo está mudando – ele digitou "obrigado" algumas vezes e até mesmo um surpreendentemente sincero "espero que esteja bem" outro dia.

É uma mudança modesta, mas talvez seja esse o ponto: às vezes, apenas algumas letras a mais podem fazer com que alguém saiba que realmente importa.

Leia o original, em inglês, aqui